Di era digital yang semakin terhubung, istilah teknologi pengolahan data besar (big data) sudah menjadi bahasa sehari‑hari banyak kalangan, mulai dari startup hingga perusahaan multinasional. Data yang dihasilkan setiap detik—dari transaksi e‑commerce, sensor IoT, hingga aktivitas media sosial—menumpuk begitu cepat sehingga menuntut cara baru untuk menyimpan, mengolah, dan mengekstrak nilai darinya. Kalau dulu kita hanya butuh spreadsheet, kini kita membutuhkan infrastruktur yang mampu menampung petabyte data dan algoritma canggih untuk mengubah angka‑angka mentah menjadi insight yang dapat ditindaklanjuti.

Artikel ini akan mengupas tuntas apa itu teknologi pengolahan data besar (big data), bagaimana cara kerjanya, komponen utama yang terlibat, serta contoh penggunaan yang menginspirasi. Tak hanya itu, kita juga akan membahas tantangan yang sering ditemui, tren terbaru, dan peluang karir yang menjanjikan di bidang ini. Semua disajikan dengan gaya santai agar mudah dipahami, bahkan bagi yang baru menyentuh dunia data.

Jika Anda penasaran bagaimana analisis data pasar menggunakan AI dapat mengubah strategi bisnis, atau ingin mengeksplorasi peluang kerja di bidang teknologi yang tengah booming, bacalah terus. Siapkan kopi, dan mari selami dunia data yang tak terbatas ini.

Teknologi Pengolahan Data Besar (Big Data): Definisi dan Konsep Dasar

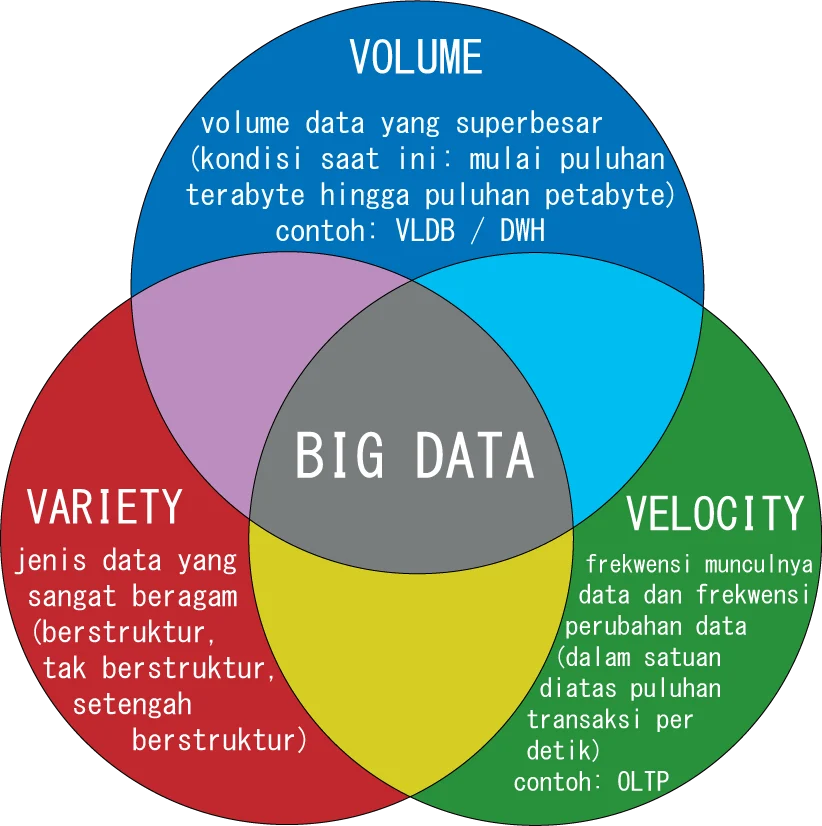

Teknologi pengolahan data besar (big data) merujuk pada sekumpulan metode, perangkat lunak, dan arsitektur yang memungkinkan organisasi untuk menangani volume, kecepatan, dan variasi data yang sangat besar. Konsep “3V” (Volume, Velocity, Variety) masih menjadi acuan utama: volume mengacu pada jumlah data yang sangat besar, velocity pada kecepatan data mengalir masuk, dan variety pada beragam format data (terstruktur, semi‑terstruktur, dan tidak terstruktur).

Untuk mengolah data ini, perusahaan biasanya mengadopsi platform terdistribusi seperti Hadoop atau Spark, yang memecah tugas menjadi bagian‑bagian kecil dan mengeksekusinya di banyak node secara paralel. Pendekatan ini mengurangi beban pada satu server tunggal dan memungkinkan pemrosesan real‑time atau near‑real‑time, yang krusial bagi aplikasi seperti deteksi penipuan, rekomendasi produk, atau pemantauan jaringan.

Komponen Utama dalam Teknologi Pengolahan Data Besar (Big Data)

- Storage: Sistem penyimpanan terdistribusi (HDFS, Amazon S3) yang dapat menampung data dalam skala petabyte.

- Processing Engine: Mesin pemrosesan seperti Apache Spark, Flink, atau MapReduce yang menjalankan algoritma analitik.

- Data Ingestion: Alat untuk mengalirkan data masuk, contohnya Apache Kafka, NiFi, atau Flume.

- Data Management: Metadata catalog, governance, dan keamanan—misalnya Apache Atlas atau AWS Glue.

- Visualization & Analytics: Platform seperti Tableau, Power BI, atau Superset untuk menampilkan hasil analisis.

Setiap komponen berperan penting. Tanpa storage yang scalable, data tidak akan muat; tanpa processing engine yang efisien, analisis akan memakan waktu berjam‑jam atau bahkan hari. Karena itu, integrasi yang mulus antar komponen menjadi kunci keberhasilan implementasi teknologi pengolahan data besar (big data).

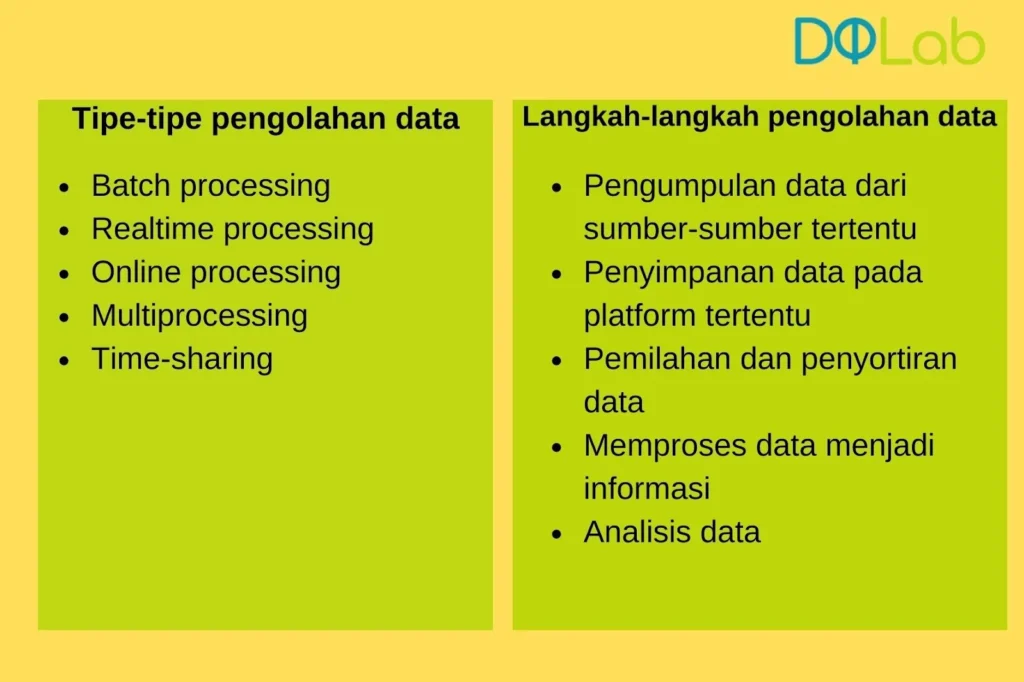

Alur Kerja Umum dalam Pengolahan Data Besar (Big Data)

Berikut langkah‑langkah umum yang biasanya diikuti:

- Pengumpulan Data (Data Collection): Menggunakan sensor, log aplikasi, API, atau layanan streaming untuk mengumpulkan data mentah.

- Pembersihan & Transformasi (Data Cleaning & ETL): Menghilangkan duplikasi, memperbaiki nilai yang hilang, dan mengubah format agar konsisten.

- Penyimpanan (Data Storage): Menyimpan data ke dalam data lake atau data warehouse tergantung pada kebutuhan analitis.

- Analisis (Data Analysis): Menerapkan algoritma statistik, machine learning, atau query ad‑hoc untuk menemukan pola.

- Visualisasi & Penyajian (Visualization & Reporting): Menyajikan temuan dalam bentuk dashboard, laporan, atau notifikasi real‑time.

- Penerapan (Operationalization): Mengintegrasikan model atau insight ke dalam sistem produksi, misalnya rekomendasi produk di e‑commerce.

Jika semua tahapan ini dijalankan dengan baik, organisasi dapat memanfaatkan data untuk meningkatkan efisiensi, mengurangi biaya, atau menciptakan produk inovatif yang lebih sesuai dengan kebutuhan pelanggan.

Contoh Kasus Penggunaan Teknologi Pengolahan Data Besar (Big Data)

Berbagai industri sudah memanfaatkan teknologi pengolahan data besar (big data) untuk meningkatkan nilai bisnis mereka. Berikut beberapa contoh yang menonjol:

1. E‑Commerce dan Rekomendasi Produk

Platform e‑commerce mengumpulkan data klik, pencarian, dan riwayat pembelian dari jutaan pengguna setiap hari. Dengan Spark atau Flink, data ini diproses secara real‑time untuk menghasilkan rekomendasi produk yang dipersonalisasi. Hasilnya, tingkat konversi naik signifikan dan rata‑rata nilai keranjang belanja (AOV) meningkat.

2. Kesehatan: Prediksi Penyakit dan Manajemen Rumah Sakit

Rumah sakit menggunakan data sensor medis, rekam medis elektronik (EMR), dan data genetik untuk memprediksi risiko komplikasi pada pasien. Algoritma machine learning yang dijalankan pada infrastruktur big data mampu mengidentifikasi pola yang tidak terlihat oleh dokter, sehingga intervensi dapat dilakukan lebih cepat.

3. Smart City dan IoT

Sensor di jalan, lampu lalu lintas, dan jaringan listrik menghasilkan data streaming terus‑menerus. Dengan menggunakan teknologi pengolahan data besar, kota dapat mengoptimalkan alur lalu lintas, mengurangi pemadaman listrik, dan meningkatkan keamanan publik.

Teknologi Terkini yang Mengubah Lanskap Big Data

Bergerak cepat, dunia big data tak henti‑hentinya berinovasi. Berikut beberapa tren yang patut diikuti:

- Edge Computing: Memproses data lebih dekat ke sumbernya (sensor, perangkat mobile) untuk mengurangi latensi.

- Data Fabric: Kerangka kerja yang menyatukan berbagai sumber data, baik on‑premise maupun cloud, sehingga akses menjadi lebih konsisten.

- Lakehouse Architecture: Kombinasi antara data lake (penyimpanan fleksibel) dan data warehouse (analisis cepat) dalam satu platform, contohnya Delta Lake atau Apache Iceberg.

- AI‑Driven Analytics: Model AI yang terintegrasi langsung ke dalam pipeline big data, memungkinkan prediksi otomatis tanpa intervensi manusia.

Jika Anda tertarik melihat bagaimana event teknologi terbesar di Asia menampilkan inovasi‑inovasi ini, jangan lewatkan kesempatan untuk mengunjungi pameran dan konferensi yang diadakan setiap tahun. Di sana, Anda bisa bertemu langsung dengan penyedia solusi big data terdepan.

Tantangan dalam Implementasi Teknologi Pengolahan Data Besar (Big Data)

Meskipun manfaatnya luar biasa, mengadopsi teknologi pengolahan data besar (big data) tidak selalu mulus. Berikut beberapa hambatan yang sering ditemui:

Kualitas Data dan Governance

Data yang tidak bersih atau tidak terstandarisasi dapat menghasilkan insight yang menyesatkan. Oleh karena itu, kebijakan tata kelola data (data governance) sangat penting untuk memastikan akurasi, keamanan, dan kepatuhan regulasi.

Skalabilitas Infrastruktur

Menjaga infrastruktur tetap scalable memerlukan investasi pada hardware, cloud services, atau hybrid solutions. Tanpa perencanaan yang matang, biaya operasional dapat melambung tinggi.

Kekurangan Talenta

Kebutuhan akan data engineer, data scientist, dan analyst yang menguasai platform big data terus meningkat. Jika tidak ada tim yang kompeten, proyek dapat terhambat atau gagal.

Keamanan dan Privasi

Data besar sering kali mencakup informasi sensitif. Memastikan enkripsi, kontrol akses, serta kepatuhan pada regulasi seperti GDPR atau UU PDP menjadi prioritas utama.

Peluang Karir dan Prospek Masa Depan

Karena teknologi pengolahan data besar (big data) menjadi inti transformasi digital, permintaan akan tenaga ahli di bidang ini terus meningkat. Posisi yang paling dicari meliputi:

- Data Engineer – merancang pipeline data dan mengelola infrastruktur.

- Data Scientist – mengembangkan model prediktif dan analitik lanjutan.

- Machine Learning Engineer – mengintegrasikan model AI ke dalam sistem produksi.

- Data Analyst – menginterpretasikan data dan menyajikannya dalam bentuk visual.

- Chief Data Officer – memimpin strategi data perusahaan secara keseluruhan.

Jika Anda ingin meniti karir di bidang ini, mulailah dengan menguasai bahasa pemrograman seperti Python atau Scala, serta memahami platform Hadoop, Spark, atau cloud services (AWS, Azure, GCP). Banyak sumber belajar gratis maupun berbayar yang dapat membantu Anda memulai perjalanan.

Tak hanya di sektor teknologi, hampir semua industri—perbankan, manufaktur, agrikultura, hingga hiburan—sedang mencari profesional yang dapat mengubah data menjadi nilai bisnis. Jadi, jangan ragu untuk mengeksplorasi peluang kerja di bidang teknologi yang relevan dengan minat Anda.

Kesimpulannya, teknologi pengolahan data besar (big data) bukan sekadar buzzword, melainkan fondasi bagi inovasi di era digital. Dengan memahami konsep dasar, komponen utama, serta tantangan yang ada, Anda dapat memanfaatkan potensi data untuk menciptakan solusi yang lebih cerdas, efisien, dan berdaya saing tinggi. Selalu ikuti perkembangan terbaru, terus tingkatkan skill, dan jadikan data sebagai aset strategis yang menggerakkan perubahan.